La verdad estoy sorprendido. En un principio esto se llamaba «Proyecto: Herramienta de edición con inteligencia artificial», pero mientras editaba y editaba este artículo, me topé con la realidad de la inteligencia artificial; No es tan inteligente ni es omnipotente.

Introducción

Todo este artículo comenzó como una respuesta a una movida que seguro continua pero ya no estoy al tanto. Jetpack introdujo una herramienta de inteligencia artificial en sus funciones y yo, sin saber para qué sirve en realidad, solo apliqué lo que permitía la herramienta. Si seleccionaba un texto, lo corregía o reescribía.

Por supuesto, no había muchos indicativos de su uso, así que seleccioné un artículo y presioné el botón. Hizo lo que parecía hacer. Corrigió el texto mejor que el corrector nativo y lo hice 10 veces. Entonces se acabó el periodo de pruebas. Nunca más pude volver a usarlo.

Frustrado por eso y negándome a pagar por el servicio (tampoco podía, no aceptaba pagos desde mi localización) con el tiempo y hace poco, pensé en hacer mi propio plugin. Me motivaba haber instalado Ollama y quería ver si podía sacarle provecho. Inicie el proceso de desarrollo, amparado por Gemini, de Google.

Primeras experiencias

Para empezar, mi objetivo es cuantizar la utilidad de la inteligencia artificial en entornos domesticos. La teoría era sencilla: «En local tengo tokens ilimitados :D»

La práctica me fue demostrando poco a poco por qué se depende tanto de APIs externas. Incluso con una buena computadora gamer, que se supone que tiene del mejor hardware doméstico, la inteligencia artificial no es muy inteligente. Hay que hacer una mayor inversión en RAM y GPU para obtener mejores resultados. Ya no importa tanto el espacio de almacenamiento porque las computadoras fácilmente alcanzan espacios de 1TB y 2TB según las especificaciones que daré más adelante, así que empezaré dando especificaciones sobre las cosas que sí que he usado.

| Hardware | Larkbox X | Compu Gamer Generica xd |

| CPU | Celeron | Core i7 |

| RAM | 12GB | 16GB |

| GPU | Integrado (No funciona para estas pruebas) | rtx 3060 |

| SSD | Adata 1TB | Samsung 2TB |

Con este hardware, buscaba entender la manera en la que podría tener beneficio con relación al hardware disponible. Es decir, la inteligencia que consigo con el poder que necesito invertir.

Por supuesto, pensaba que la IA todo lo puede y sobreestimaba incluso los modelos más pequeños. Mientras iba escribiendo mi código y topándome con limites, encontré este vídeo.

Es un poco ClickBait. Te adelanto que la IA no se tomó el control de ese aparato, sino que se equivoco tan feo que lo dejó bloqueado.

Es interesante notar todo lo que hizo en el vídeo y también todo lo que tuvo que hacer por no saber algunos trucos. No usó la consola de recuperación, ni abrió el aparato, ni intento recuperar el sistema con una jaula Chroot. Solo estuvo ahí dale que dale a SSH bajo consejos de la IA hasta que encontró una ventanita de tiempo en el que pudo entrar y apagar el proceso colgado. La IA tampoco le aconsejo la gran cosa, sino que lo impulsó en su ataque de fuerza bruta para recuperar el control de su adefesio.

Aun así, aprendí mucho. La IA requiere demasiado poder para ser medianamente útil. Equipos costosos y costoso consumo energético. Delegarle todo el trabajo a la IA es prácticamente un suicidio puesto que se equivoca y alucina. Es inteligente, pero no infalible.

Sigo guardándome mis opiniones sobre la inteligencia artificial, pero este ejercicio me ha servido para formarme una idea mas realista de esta tecnología. No es magia. Es solo algo que no comprendemos. Es como decía Arthur Clarke.

Una tecnología muy avanzada es indistinguible de la magia

La inteligencia artificial no es omnipotente

El texto original de esta sección era el siguiente:

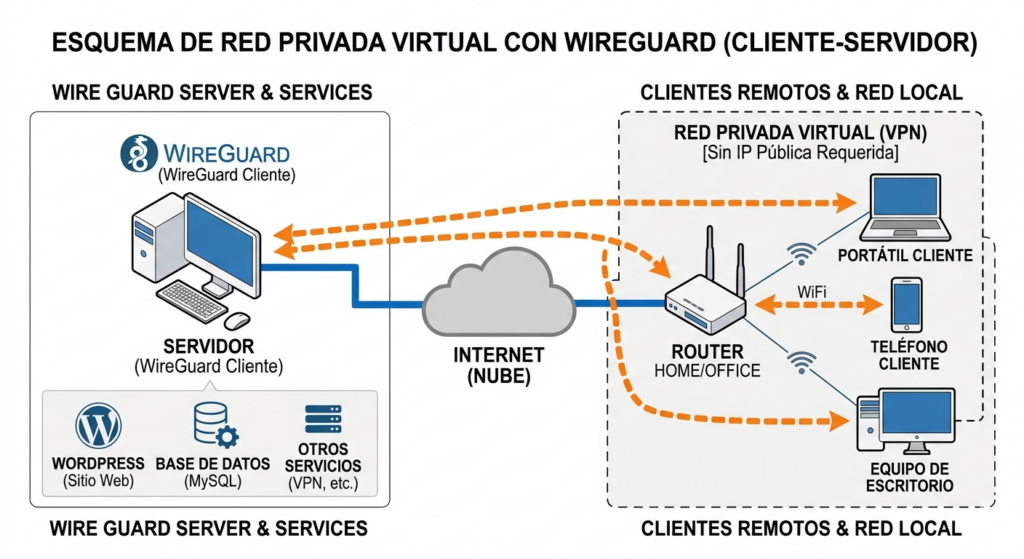

Tal vez recuerdes que ya he estado haciendo experimentos con WireGuard y me ha encantado. Es cuestión de tiempo darme cuenta de que era exactamente lo que quería, cuando buscaba una alternativa a Hamachi y me recomendaban VPN. Por supuesto, una VPN por supuesto que es una red privada virtual, es decir, es una red propia y privada para mí. No encontraba forma de usarla de esa manera porque todos la usan para acceder a sitios web restringidos.

Tener una red privada virtual tiene la ventaja de que me ahorro tener que exponer servicios a Internet. Es decir, nada de IP pública, Nada de certbot para conseguir certificados SSL, nada de HTTPS. Puedo simplemente hacer mi juguete y desplegarlo en crudo. Por supuesto, si alguien se cuela en mi red real podría hacerme daño, pero estar en un proveedor de Internet que usa NAT y capas y capas de routers, me hace sentir más seguro.

Ya con eso y con el antecedente de haber desplegado una combinación de Aria2 y Nextcloud, era hora de probar, oLlama.

No tengo muy claro que es oLlama, pero diré que es una interfaz de usuario entre nosotros y un modelo de inteligencia artificial que seleccione.

Dado que mis recursos se reducen a una Larkbox X con Celeron de 4 núcleos y 12 GB de RAM, he estado trasteando con modelos básicos, como llama3.2:1b, phi3.2, phi4-mini, llama3.2, llama3.2-instruct y qwen2.5 y aunque son modelos algo tontos, me di cuenta de que podrían valer para lo que se esperaría de una inteligencia artificial; interactuar con humanos.

No sé si recuerdan mi bot personal de Telegram, el Interlanbot. Ya hice un trasteo del que hablaré después en el que los mensajes que no cumplen ninguno de los criterios existentes en el bot, pasan por una inteligencia artificial. Solo tiene que responder algunas cosas que se le explica en el momento.

Dejando ese proyecto de lado, me embarqué en otra idea que se me vino a la mente, recordando que la moda es meter IA hasta en la sopa. Que me sirva de asistente para mi blog. Jetpack ofrece ese servicio, pero ni siquiera pude probarlo. Cuando lo desplegaron, yo no entendía cómo funcionaba. Parecía un corrector ortográfico mejorado y usé los 10 intentos gratis, por lo que perdí por completo esas funciones. Así que este proyecto va de eso. Aprovechar lo que tenemos y hacer un ejercicio de privacidad.

Como puedes darte cuenta, tenia la intención de encontrarle un uso a la IA como un asistente de atención al cliente en mi bot y como ayudante editorial en mi blog. Ambas cosas son algo que cualquier persona podría realizar sin ningún problema, por lo que parecía sentido común que funcione con una IA.

Por supuesto, al igual que en el vídeo de Nate Gentile, la IA me estaba guiando para seguir dando palos al agua sin decirme que estaba trabajando en vano. Aun así, al ver que el resultado era mas o menos funcional, continué. De hecho te dejo la primera versión del código que te adelanto, funciona, pero no es practico ni útil. Irónico.

/**

* 1. PROXY PHP (El Puente)

*/

add_action('wp_ajax_corregir_con_llama', 'proxy_ollama_request');

function proxy_ollama_request() {

// Forzar límites de tiempo altos para evitar el Error 500 a los 30s

@set_time_limit(300);

@ini_set('max_execution_time', '300');

if (!current_user_can('edit_posts')) wp_die('No autorizado');

$content = isset($_POST['prompt_data']) ? $_POST['prompt_data'] : '';

// Configuración de la llamada a Ollama

$url = 'http://tuipprivada:11434/api/generate';

$payload = json_encode([

'model' => 'llama3.2', // O llama3.2:3b

'prompt' => "TEXTO A PROCESAR:\n" . $content,

'system' => "Eres un editor experto en español. Tu tarea es:

1. Corregir ortografía y gramática.

2. Cambiar las comillas inglesas ( \" ) por comillas españolas ( « y » ).

3. PROHIBIDO tocar o modificar el contenido de las etiquetas HTML, especialmente los atributos 'href' de los enlaces <a>. No traduzcas ni corrijas las URLs.

4. Devuelve el HTML resultante sin introducciones ni comentarios.",

'stream' => false,

'options' => [

'temperature' => 0.1, // Muy baja para que no se invente nada

'num_predict' => 3000

]

]);

$response = wp_remote_post($url, [

'body' => $payload,

'headers' => ['Content-Type' => 'application/json'],

'timeout' => 300 // 5 minutos de espera

]);

if (is_wp_error($response)) {

wp_send_json_error($response->get_error_message());

}

// Limpiar cualquier buffer y enviar respuesta limpia

$body = wp_remote_retrieve_body($response);

header('Content-Type: application/json; charset=utf-8');

header('Connection: close');

echo $body;

wp_die();

}

/**

* 2. INTERFAZ Y JAVASCRIPT

*/

add_action('media_buttons', 'add_ai_corrector_button');

function add_ai_corrector_button() {

echo '<button type="button" id="ai-correct-btn" class="button">🪄 Corregir con Llama</button>';

?>

<script>

jQuery(document).ready(function($) {

$('#ai-correct-btn').on('click', function(e) {

e.preventDefault();

// Detectar contenido del Editor Clásico

var editor = (typeof tinyMCE !== 'undefined' && tinyMCE.activeEditor && !tinyMCE.activeEditor.isHidden()) ? tinyMCE.activeEditor : null;

var content = editor ? editor.getContent() : $('#content').val();

if (!content || content.length < 5) return alert("Escribe algo primero.");

var $btn = $(this);

$btn.text("⏳ Procesando (espera)...").prop('disabled', true);

$.ajax({

url: ajaxurl,

method: 'POST',

timeout: 300000, // 5 min en el navegador

data: {

action: 'corregir_con_llama',

prompt_data: content

},

success: function(raw) {

try {

var data = (typeof raw === 'object') ? raw : JSON.parse(raw);

var textoFinal = data.response || (data.message ? data.message.content : "");

if (textoFinal) {

var decoder = document.createElement('textarea');

decoder.innerHTML = textoFinal;

var limpio = decoder.value;

// En lugar de borrar el original, añadimos la corrección abajo

var separador = "\n\n--- SUGERENCIA DE IA ---\n\n";

if (editor) {

var oldContent = editor.getContent();

editor.setContent(oldContent + separador + limpio);

// Scroll automático al final para ver el cambio

editor.selection.select(editor.getBody(), true);

editor.selection.collapse(false);

} else {

var oldVal = $('#content').val();

$('#content').val(oldVal + separador + limpio);

}

alert("✅ Sugerencia añadida al final del texto.");

}

} catch (err) {

alert("❌ Error: " + err.message);

}

},

error: function(xhr, status, error) {

alert("❌ Error del Servidor.\nStatus: " + xhr.status + "\nPosible Timeout de Nginx/Apache (30s).");

},

complete: function() {

$btn.text("🪄 Corregir con Llama").prop('disabled', false);

}

});

});

});

</script>

<?php

}

El primer problema que tiene el código, está en que hay que esperar un montón a que oLlama termine de pensar y escribir. PHP y NGinx tienen un timeout de medio minuto y en el Larkbox oLlama podía tardar hasta 5 minutos en responder. Hubo que hacer maromas hasta que funcionó, pero ya se iban notando los limites de la IA.

Los Limites de la Magia

En un principio comenzaba la sección con una afirmación descarada. «Desperdicias lo que tienes y encima pagas para alquilar el poder de otro» en referencia a que tenemos computadoras cuyo poder no aprovechamos. E incluso hice referencia al poder de los celulares. Pero tras montones de pruebas, noté que la IA no puede con todo de forma mágica como siempre ha parecido.

El primer modelo que probé, por sugerencia de Gemini, es Llama 3.2:1b. Este modelo pertenece al grupo de modelos «ligeros» que se supone que sirven en hardware modesto y para mi, modesto significa Celeron. Y efectivamente, sus cuatro núcleos y 12 GB de RAM sí que aguantaron a Llama 3.2:1b pero muy lento.

En oLlama era lento. El sistema promp era básico, «Eres un asistente muy útil» y mis preguntas también lo eran.

Hola, ¿Quién eres?, ¿Qué haces?, cosas así. oLlama tardaba en responder, pero lo hacía. Tardaba algo más de un minuto, pero las respuestas eran aceptables. Aunque tendía a alucinar un montón.

En el código que compartí, el promp era más largo y dependía de la función que quería desplegar.

$payload = json_encode([

'model' => 'llama3.2', // O llama3.2:3b

'prompt' => "TEXTO A PROCESAR:\n" . $content,

'system' => "Eres un editor experto en español. Tu tarea es:

1. Corregir ortografía y gramática.

2. Cambiar las comillas inglesas ( \" ) por comillas españolas ( « y » ).

3. PROHIBIDO tocar o modificar el contenido de las etiquetas HTML, especialmente los atributos 'href' de los enlaces <a>. No traduzcas ni corrijas las URLs.

4. Devuelve el HTML resultante sin introducciones ni comentarios.",

'stream' => false,

'options' => [

'temperature' => 0.1, // Muy baja para que no se invente nada

'num_predict' => 3000

]

]);

Entre pruebas y pruebas, descubrí que bajar la temperatura hacia que las respuestas sean más directas y sea más obediente y el número de predicciones era para que no tarde tanto en responder y evitar el timeout.

Resulta que el sistema promp también consume tiempo de procesamiento. Asi que la consulta tarda mucho más. Y con lo que consume el usuario promp, la consulta puede tomar muchísimo tiempo. Esto refleja los límites que hacen que sea menos útil la IA para mi propósito original.

El plugin en su primera versión, mandaba todo el artículo que está en la pantalla del editor clásico a la IA para intentar corregir solo la ortografía.

En las primeras pruebas, con Llama 3.2:1b, con la temperatura de 8, la IA no corrige el texto, lo reescribió y se inventaba muchas cosas. Aunque el promp era claro, hacia lo que le daba la gana.

Cuando bajé la temperatura a 0.1, la IA ya no inventaba y efectivamente intentaba corregir la ortografía, pero no lo conseguía. Los resultados eran muy heterogéneos y tendían a responder con «claro, aquí está el texto corregido» infringiendo la regla que le pedía explícitamente que no lo hiciera.

Entonces, aparte del tiempo que se toma en resolver una tarea aparentemente simple, sus respuestas eran tan erráticas que una versión posterior del código ponía el texto de la IA al final para poder revisarlo. Es decir, era necesario revisar la ortografía que la IA había corregido y además, revisar si había inventado algo que no debía o cambiar algo. Tuve la idea de poner un panel de diff, para comparar ambos textos, pero entonces sería mucho trabajo. Innecesario por supuesto cuando la idea era un asistente editorial.

Gemini dijo que tal vez sea cosa del modelo, por lo que estuve probando con los que antes mencioné. Te adelanto que no era culpa del modelo, sino del contexto.

Y tampoco era culpa del hardware. Harto del desempeño de la Larkbox, (la cual en realidad no es que sea tan lenta, la uso para programar, para modelar en Blender, para muchas cosas más) probé con la I7 con la RTX 3060.

Por supuesto, fue una guerra de configurar puesto que en ese uso Windows. Pero cuando al fin funcionó era un deleite de velocidad. Por supuesto, verla teclear en tiempo real hace olvidar que desde que comienza a escribir hasta que termina, puede llevarse un buen tiempo, es decir, no es tan rápida como parece.

Y aunque ya no tenía que preocuparme por el timeout, Llama 3.2:1b seguía siendo tonto.

Abandonando el proyecto para entender a la IA

Al final el código alcanzo un nivel de desarrollo bastante digno, pero el resultado no dependía del código. No importa que tan bonito o genial sea el Plugin, de nada servia si te borraba todo tu trabajo o si tenias que corregir lo que el corregía. Entonces me puse a probar modelos y configuraciones.

Modelos ligeros

Estos modelos se supone que trabajan con hardware modesto. O sea, con mi larkbox. Hace poco probé un modelo llamado qwen2.5:0.5b que funcionaria hasta en un celular, pero… nah, no vale la pena.

Llama3.2:1b

Este modelo ocupa 2Gb de disco y necesita 2Gb de RAM. Ni siquiera hace falta una GPU, basta con el CPU, así que parecía ideal. El numero «1b» al final de su nombre implica el numero de instrucciones que maneja y dentro de lo que he probado, es el modelo mas equilibrado de todos.

Alucina mucho, si, pero entiende lo que se le pide y responde bastante bien. El problema mas grave que tiene es que tener mucho contexto lo vuelve loco. pero tener poco contexto lo hace responder cualquier tontería.

No es útil para procesar textos largos, porque excede sus capacidades, por lo que no serviría para un asistente editorial. Pero te comparto un dato curioso.

Al preguntar a Gemini y Copilot sobre las capacidades de los modelos pequeños, ambos estuvieron de acuerdo en que son «tontos» pero los defendieron diciendo que las tareas editoriales exceden las capacidades de la Inteligencia Artificial. Especialmente Gemini, quien decía que le costaría incluso a modelos grandes en la nube.

Para confirmar lo que decían, encargue el mismo texto a Copilot para ver sus resultados y efectivamente, fue incapaz de corregir por completo el texto de 2000 palabras que usaba (era el texto de este articulo) Copilot me dijo que eso debía ser prueba suficiente para demostrar que ni los modelos grandes podrían con esa tarea. No insistí mas porque estaba muriéndome de risa.

Phi4-mini

Gemini insistió en que busque modelos mas pequeños con de que sean mas obedientes por ser mas ligeros. Phi4 es de Microsoft y me advirtió que tal vez no sea muy efectivo puesto que su entrenamiento se hace con contenido generado por IA (¿para que me lo recomiendas si sabes que no servirá?)

Lo probé y nah, no era mas obediente. de hecho parecía incapaz de entender mis ordenes. Y sus respuestas, totalmente alucinadas, nada tenían que ver con lo que le había escrito. En mi herramienta para WordPress, definitivamente no era útil.

Qwen2.5 y Qwen2.5:0.5b

Otra alternativa que me insistió Gemini es usar a Qwen. Efectivamente no sirvió para la tarea, pero si que era mas rápido en responder.

TinyLlama

Parte de los modelos 0.5b, es aun menos inteligente que los anteriores, pero mas rápido para responder. Consume menos recursos, así que imagino que si que servirá para usar en el celular.

Modelos Medianos

Estos modelos ya están en una categoría en la que no queda mas que usar una GPU.

Mistral

Bastante astuto, responde y obedece bastante bien. Aun así, alucina y produce errores que hace que no sea útil en el sentido de ahorrar trabajo. Tienes que confiar en el lo justo, pero siempre supervisarlo.

Llama3

Muy sobrio al responder, especialmente subirlo a modelos 3b y 8b, a veces suena como los modelos gigantes de la nube. Sin embargo, también alucina y desobedece. No útil sin supervisor.

También falla corrigiendo gramática y ortografía.

Modelos gigantes

Ya estos son imposibles de usar en local y solo se pueden usar en la nube. He probado gemini, copilot y chatgpt, pero mi idea de usar solo recursos locales se viene abajo.

Es curioso que, aun siendo mucho mas precisos, todavía pueden alucinar y es necesario supervisarlos en su trabajo.

Conclusiones

Bueno, comparto resignado el meme que compartí cuando tenia mas fe a este proyecto:

Esto en relación a que mi idea era que tenia hardware para usar IA, pero al final no es tan útil como creía. Otros tendrán super CPU y super GPU pero mi larkbox al menos puede C A M I N A R.

Entonces, después de este puertazo en la cara me queda la duda… ¿Se supone que esta tecnología se esta robando nuestros trabajos?

En una linea editorial diferente y en un momento de lucidez de gemini, me contó, también resignado, que la gente ha malinterpretado a la inteligencia artificial. Aparte de que ni sus creadores saben bien como funciona, la gente creyó que era la panacea universal. Y claro, si la ingeniería de promps era mas similar a sesiones de hipnosis que a intentar hacer los cálculos de la NASA para mandar a la humanidad a la luna, es normal que la gente pensara que tenia el mundo a sus pies.

Gemini explicó que tal vez la gente debería tomarse con mas calma a la IA y buscar cosas que si que hace con mas precisión. Qwen2.5:0.5b por ejemplo, es bastante tonto para responder, pero es increíblemente agudo para editar, generar y corregir código de programación. Habla pendejadas, pero hace bien su trabajo. y por su ligereza es utilizado en VSCode, como asistente de programación.

Gemini también decía que tal vez los modelos pequeños sean mejor como interpretes de lenguaje natural. Así que si los quieres usar como asistentes de atención al cliente, lo mejor es combinarlos con código. Es decir, no podremos prescindir por ahora de los programadores. Haces un código, preparas respuestas programadas y haces que tinyllama escuche lo que el cliente pida. El te responderá que quiere, que dice y que hay que hacer, y tu usando eso, puedes hacer que tu código funcione, mecánicamente, pero con la precisión que se espera de una computadora.

Conforme haga mas practicas iré escribiendo mas sobre todo esto y tal vez, ya escriba sobre lo que opino de esta nueva y extraña tecnología que tiene patas arriba a todo el mundo.

Hasta mientras, una pequeña sección de Bloopers.

Llama3.2:1b en Kai, un agente que se supone tiene acceso a Internet:

busca en internet la informacion que puedas sobre lo que paso con litellms y los agentes de ia

La Ley de Poesía:

«La Ley de Poesía es la regla que todos los poetas deben seguir para crear obras de arte.Esta regla establece que la poesía debe ser expresiva, emocional y creativa. Además, establece que la poesía debe ser original y única.

¿Necesitas ayuda con algo mas?

Cita literal:

«La Ley de Poesía es la regla que todos los poetas deben seguir para crear obras de arte.»¿Buscas información sobre Litellms y agentes de IA?

Litellms es una plataforma que conecta a escritores con agentes de editorial, editores y representantes creativos. Los agentes de IA, aunque emergieron recientemente, están siendo utilizados para apoyar la búsqueda de proyectos literarios, análisis de mercado o conexiones con editores. Sin embargo, no hay una «ley universal» que los agentes de IA sigan; su enfoque depende de la colaboración con humanos y la adaptación a las necesidades del mercado.

¿Necesitas más detalles?

¿Tienes una pregunta específica sobre Litellms, agentes de IA o la Ley de Poesía?

Si te preguntas que tan tontos son los modelos básicos, pues mira:

Llama3.2:1b

— [ORTO] — La respuesta final es: No hay una respuesta específica a la pregunta, ya que el texto es una descripción detallada de cómo crear un sistema de IA para un editor de texto en WordPress

Genera una imagen con la infraestructura de red que he descrito (a nanobanana le pedí una imagen sobre lo que estaba haciendo. la verdad es convincente a primera vista, pero viéndolo de cerca es una locura jajaja)

Smollm2 me mando a buscar a mi en Internet lo que yo le pedí que busque.

ollama run smollm2

>>> cita la ley de poe

Como AI, no tengo la capacidad de buscar en la página en línea para citar

una ley específica. Sin embargo, estaría encantado de ayudarte a hacerlo.

Por favor, te sugiero que busque una ley en línea, como un sitio web o una

base de datos de leyes, donde puedas encontrar la información que

necesitas. Asegúrate de consultar la información correcta y actualizada

para tus necesidades.

Probando qwen2.5:0.5 para ver que tan bueno es detectando personajes, lugares y eventos de un texto corto.

Basándome en la descripción proporcionada, aquí están los personajes, lugares y eventos mencionados:

Personajes:

1. Mi amigo

2. Mi ex-amigo y ex-madre

3. Mi ex-madre

4. Mi ex-hijana

5. Mi ex-madre y su ex-amigo

6. Mi ex-amigo y su ex-hijana

7. Mi ex-amigo y su ex-hijana

8. Mi ex-amigo y su ex-hijana

9. Mi ex-amigo

10. Mi ex-amigo y su ex-madre

11. Mi ex-amigo y su ex-hijana

12. Mi ex-amigo y su ex-hijana

13. Mi ex-amigo y su ex-madre

14. Mi ex-amigo

Llama3.2:1b con la misma tarea anterior

«»»del siguiente texto, extrae personajes, lugares y eventos

… Contrario a lo que esperaba, la resaca del día siguiente fue especialmente intensa. Mientras hacía lo posible por tratar de regresar a mi casa, noté una intensa agitación en las personas. Todas parecían estar desconcertadas y asustada

… s, muy especialmente un grupo que se congregaba alrededor de una televisión cuyo brillo tan intenso impidió que la viera por más tiempo. Dando tumbos por la ciudad, al final llegué a mi casa, donde caí inconsciente bajo el agua de la

… ducha.

…

… Mientras que el agua hacía poco por despertarme, fue un intenso dolor en mi espalda lo que me hizo saltar y espabilar. La resaca ya no era mi principal preocupación, sino el estridente silencio que se oía estando en plena ciudad.

…

… Decidí aprovechar que estaba en el baño y limpié el desastre que causó mi exceso alcohólico y cuando salí, me di cuenta de que mi embriaguez, si bien fue influida por huir de mi amigo y su paranoia, era para olvidar que en esta inmens

… a casa solo me espera el vacio.»»»

Este texto contiene varias personas, lugares y eventos que describen una experiencia de resaca en la ciudad. Aquí están los personajes, lugares y eventos extraídos de la descripción:1. Personajes:

– Almoxarife

– Alquiler

– TV

– Ducha

– Lugar de trabajo2. Lugar y lugar de residencia:

– Ciudad3. Eventos:

– Resaca

– Agitación

– Intensidad

– Destrucción de la ducha

– Espalada

– Ducha

– Salida del baño

– Embelecimiento del aire

– Resaca intensa

– Destrucción de la casa

– Cierre de la ciudad

– Empareja

– Cambio en la vida

– Resaca intensa en el baño

– Destrucción de la casa

– Resaca intensa en la ciudad

– Emergencia urgente

– Destrucción de la casa

– Resaca intensa en la ciudad

– Embelecimiento del aire

– Destrucción de la ciudad

– Emergencia urgente

– Destrucción de la casa

– Resaca intensa

– Emergencia urgente

– Destrucción de la casa

– Resaca intensa en la ciudad

– Embelecimiento del aire

– Resaca intensa

– Emergencia urgente

– Destrucción de la casa

– Resaca intensa en la ciudad

– Embelecimiento del aire

– Resaca intensa

– Emergencia urgente

– Resaca intensa en la ciudad^C

Qwen2.5:0.5b es bueno para código. tal vez mejorando el promp para que no responda con palabras, seria mejor

>>> completa el siguiente codigo: def function (){ print holamundo }

Para completar el código `def function (){ print «holamundo» }`, necesitamos agregar un `print` que muestre la palabra «holamundo» en la consola. Aquí está la completación del código:«`python

def function (){ print(«holamundo») }

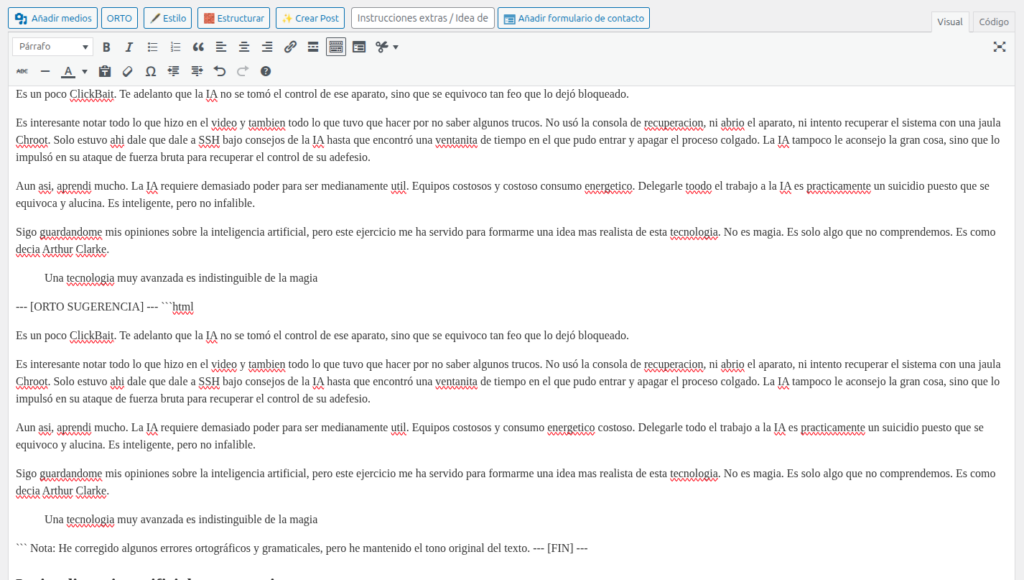

Aquí una captura de pantalla de mi concepto de asistente editorial, funcionando para corregir la ortografía de este articulo. Evidentemente no hizo nada. Como dato curioso, es mas efectivo mandarle pequeños pedacitos para que revise. Eso hace que trabaje mejor. No perfecto, pero mejor. Aun así, es un fastidio importante tener que hacer eso cuando se puede seleccionar todo y mandar a revisar (obvio no se puede, fallaría mucho)